Xiaomi ha desarrollado un modelo de IA con 4,7 mil millones de parámetros que combina percepción visual, habla y control para robots.

Xiaomi entra al mercado de la robótica

El gigante chino de dispositivos móviles y hogares inteligentes, conocido como Xiaomi, anunció un nuevo paso: el desarrollo de su propio modelo de inteligencia artificial para robots. La compañía presentó Xiaomi‑Robotics‑0, un sistema de código abierto que combina reconocimiento visual, comprensión del lenguaje y control de acciones en tiempo real. El modelo cuenta con 4,7 mil millones de parámetros y ya ha establecido varios récords tanto en simulaciones como en la práctica.

Cómo funciona el modelo

El robot normalmente sigue el ciclo «percepción → decisión → acción». Xiaomi‑Robotics‑0 equilibra una comprensión amplia de la situación con un control preciso de la motricidad gracias a la arquitectura Mixture‑of‑Transformers (MoT).

1. Modelo visual-lingüístico (VLM) – el “cerebro” del sistema.

* Entrenado para interpretar comandos, incluso borrosos (“por favor, dobla la toalla”).

* Comprende relaciones espaciales basadas en imágenes de alta calidad.

* Tareas: detección de objetos, respuestas a preguntas visuales y razonamiento lógico.

2. Experto en acciones (Action Expert) – generador de movimientos.

* Basado en un transformador difuso (DiT).

* No genera una acción a la vez; forma secuencias de acciones mediante el alineamiento de flujos, lo que garantiza fluidez y precisión.

Entrenamiento sin pérdida de comprensión

Los VLM habituales pierden parte de sus habilidades perceptivas al entrenarse en tareas físicas. Xiaomi resolvió este problema entrenando simultáneamente el modelo con datos multimodales (imágenes + texto) y datos de acción. El proceso de entrenamiento consta de varias etapas:

1. Propuesta de acciones – el VLM predice posibles distribuciones de acciones sobre las imágenes, sincronizando la representación interna con operaciones reales.

2. Luego el VLM se “apaga”, y DiT recibe un entrenamiento separado para generar secuencias precisas a partir del ruido, basándose en características clave en lugar de tokens lingüísticos.

Minimización de retrasos

Para eliminar pausas entre las predicciones del modelo y los movimientos reales del robot se utiliza una salida asíncrona: el cálculo de IA y la acción del robot están separados. Esto permite que los robots se muevan continuamente incluso cuando se necesita un cálculo adicional.

* Clean Action Prefix – método para recuperar la acción previamente predecida, garantizando fluidez sin sacudidas.

* La máscara de atención se centra en la secuencia visual actual, ignorando estados anteriores, lo que hace al robot más receptivo a cambios repentinos del entorno.

Resultados

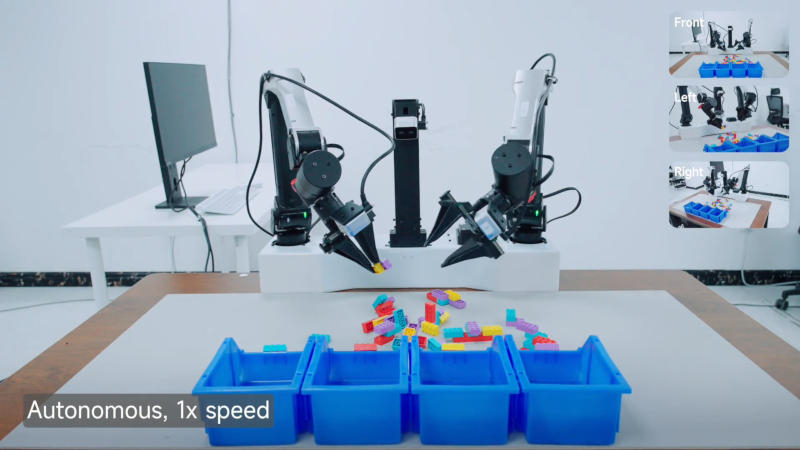

En entornos simulados LIBERO, CALVIN y SimplerEnv Xiaomi‑Robotics‑0 superó a alrededor de 30 competidores. En un robot real con dos manipuladores, el modelo logró con éxito tareas complejas: doblar toallas, desmontar un constructor. El robot demostró una coordinación estable entre manos y ojos, manipulando objetos de manera igualmente efectiva en diversos escenarios.

Así, Xiaomi no solo amplió su cartera de productos, sino que también sentó las bases para futuras investigaciones en el campo de la “inteligencia física” de los robots.

Asted Cloud

Asted Cloud

Comentarios (0)

Comparte tu opinión — por favor, sé amable y mantente en el tema.

Inicia sesión para comentar