Nvidia lanzó el chip Groq 3 LPU, que acelera la inferencia de modelos de IA hasta el nivel de tokens.

Nvidia revela nuevas capacidades de la plataforma Vera Rubin

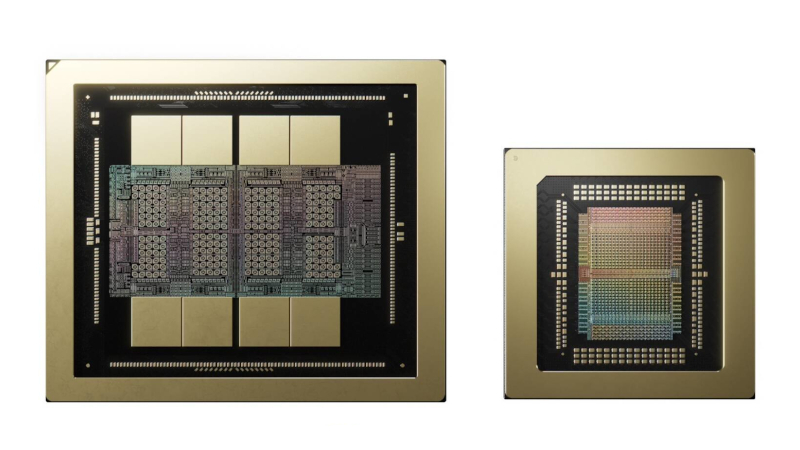

En la conferencia GTC de este año, el director ejecutivo de Nvidia, Jensen Huang, anunció la expansión de la plataforma Vera Rubin. La base de las nuevas funcionalidades es la propiedad intelectual adquirida a la empresa Groq, y en Rubin se incorporó el chip *Groq 3 LPU* – un acelerador de inferencia diseñado para generar tokens con alta velocidad y baja latencia.

Lo que ya existe en Vera Rubin

La plataforma consta de seis componentes clave que Nvidia agrupa en sistemas de rack y escala a grandes fábricas de IA:

| Componente | Descripción |

|---|---|

| GPU Rubin | Tarjeta gráfica con 288 GB HBM4 |

| CPU Vera | Procesador central |

| NVLink 6 | Sistema de escalado intra-sistema |

| ConnectX‑9 | Adaptador de red inteligente |

| BlueField‑4 | Procesador de datos |

| Spectrum‑X | Conmutador de escalado inter-sistema con óptica integrada |

El *Groq 3 LPU* ahora se añade como un nuevo bloque constructivo que se utilizará al desplegar sistemas grandes.

Por qué destaca el Groq 3 LPU

La principal diferencia es la arquitectura de memoria. Mientras que la mayoría de los aceleradores usan HBM como memoria de trabajo, cada *Groq 3 LPU* contiene 500 MB SRAM. Comparación:

| Parámetro | GPU Rubin (HBM4) | Groq 3 LPU (SRAM) |

|---|---|---|

| Capacidad | 288 GB | 0,5 GB |

| Ancho de banda | ~22 TB/s | hasta 150 TB/s |

Para tareas de inferencia sensibles al ancho de banda, la ventaja del SRAM es evidente. Por eso Nvidia incluyó el Groq 3 en Rubin – para aumentar la velocidad de emisión de tokens.

Rack Groq 3 LPX

El rack contiene 256 chips *Groq 3 LPU*, lo que proporciona:

- 128 GB SRAM

- 40 PB/s de ancho de banda total

- 640 TB/s de interfaz intra-sistema

El vicepresidente de soluciones hiper‑escalables, Ian Buck, describió este rack como un coprocesador para Rubin, subrayando su papel en la mejora del rendimiento de decodificación en cada capa del modelo y token.

Impacto en sistemas multiagente

Buck señaló que el *Groq 3 LPX* será un elemento clave para el futuro mercado de IA – sistemas multiagente. Cuando los agentes intercambian datos directamente, en lugar de a través de chatbots, las demandas de respuesta cambian: de 100 tokens/s hasta más de 1 500+ tokens/s y superiores.

Competidores y perspectivas

El texto menciona al competidor Cerebras, que utiliza el Wafer‑Scale Engine (WSE) con enorme SRAM para inferencia de baja latencia. OpenAI ya ha empleado Cerebras en sus modelos avanzados gracias a la latencia favorable.

Buck también observó que la aparición del *Groq 3 LPU* podría reducir la dependencia del acelerador Rubin CPX. Mientras Nvidia se centra en integrar el rack *Groq 3 LPX* con la plataforma, ambos chips están destinados a reforzar la inferencia sin necesidad de grandes volúmenes de memoria GDDR7.

Conclusión:

El nuevo chip *Groq 3 LPU* y su rack LPX potencian a Vera Rubin en el segmento de inferencia de baja latencia, abriendo camino hacia sistemas IA multiagente más rápidos y compitiendo con jugadores como Cerebras.

Asted Cloud

Asted Cloud

Comentarios (0)

Comparte tu opinión — por favor, sé amable y mantente en el tema.

Inicia sesión para comentar